В «Лаборатории Касперского» рассказали об отношении россиян к дипфейкам

. Только каждый десятый респондент хотя бы раз пользовался ИИ«Лаборатория Касперского»: только каждый десятый россиянин пользовался искусственным интеллектом

Россияне видят перспективы, но также осознают риски от использования дипфейк-технологий, умных чат-ботов и генераторов изображений. Об этом РБК Life рассказали в «Лаборатории Касперского» на основе результатов нового опроса New Kaspersky. В нем участвовали 1217 человек со всей России.

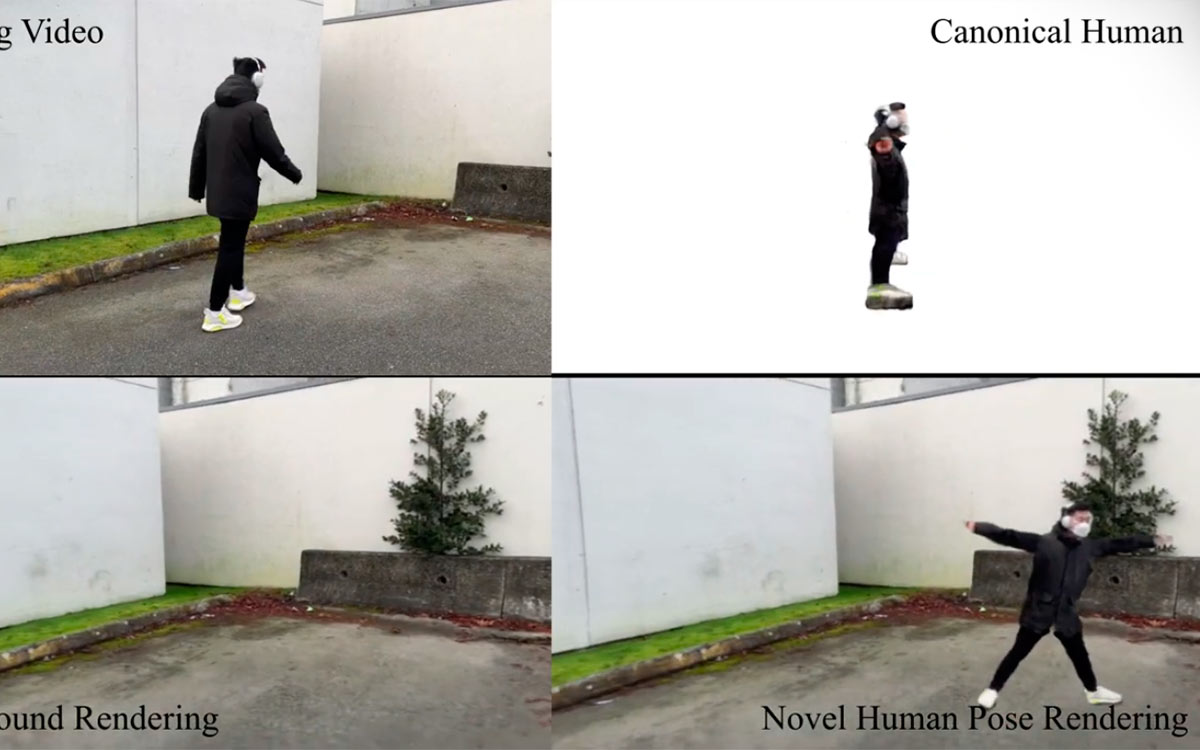

Технология искусственного интеллекта под названием deepfake (от deep learning, «глубинное обучение», + fake, «подделка») позволяет с использованием машинного обучения создавать подделки изображений, видео- или аудиоданных.

64% респондентов сказали, что что-то слышали о таких технологиях, как дипфейк, чат-боты (например, ChatGPT) и генераторы изображений (Midjourney). При этом почти каждый десятый хотя бы раз пользовался ими: 11% — чат-ботами и генераторами изображений, 9% — инструментами для создания дипфейков. Россияне считают генераторы изображений самым перспективным направлением искусственного интеллекта (его назвали 43%). Несколько процентов им уступили умные чат-боты.

Говоря о рисках, респонденты высказывают опасение, что из-за развития нейросетей многие могут лишиться работы. Угрозой для рынка труда чат-ботов считают 30%, генераторов изображений — 25%, а дипфейк-технологии — 22%.

Владислав Тушканов, руководитель группы исследований и разработки технологий машинного обучения в «Лаборатории Касперского» рассказал, что нейросети уже глубоко проникли в работу дизайнеров и копирайтеров, а разработчикам ПО они помогают повысить эффективность при написании кода. При этом не стоит бояться, что искусственный интеллект начнет лишать людей работы.

«В «Лаборатории Касперского» машинное обучение используется уже порядка 18 лет и помогает обрабатывать огромное — за пределами возможностей человека — количество потенциально опасных объектов и событий, — признался Тушканов. — Технологии не заменяют специалистов, а освобождают их от рутинных задач и позволяют сконцентрироваться на изучении более сложных киберугроз. Такое взаимодополнение позволяет обеспечить нашим пользователям более эффективную защиту».

Что касается использования технологий в незаконных целях, почти половина россиян (45%) считают, что злоумышленники могут воспользоваться дипфейк-технологиями, 36% — умными чат-ботами, 27% — генераторами изображений. При этом 26, 20 и 17% соответственно боятся, что мошенники используют их в отношении лично них.

Правда, эксперт поспешил успокоить и заверил, что новые технологии, такие как умные чат-боты, не используются в столь крупных масштабах. «Что касается другой нашумевшей технологии — дипфейк, то немногочисленные случаи ее применения мошенниками на практике, по сути, сводились к скаму», — отметил Дмитрий Галов, руководитель российского исследовательского центра «Лаборатории Касперского».

Скам — это мошеннический инвестиционный проект. Само слово имеет английские корни и означает мошенничество с целью получения быстрой выгоды. В инвестициях скамом называются проекты, которые оттягивают или перестают выплачивать проценты и дивиденды, нарушают условия сделок.

Галов добавил, что злоумышленники выдавали себя за разных известных людей и продвигали мошеннические схемы, пытаясь таким образом выманить у жертв деньги или личные данные. «Конечно, нельзя исключать, что в будущем объемы подобного мошенничества увеличатся», — заключил он.

Специалисты «Лаборатории Касперского» назвали следующие правила, которые помогут не попасться на уловки злоумышленников:

- критически относиться к любой информации в сети и мессенджерах;

- не переходить по ссылкам из сомнительных сообщений;

- регулярно обновлять операционную систему на личных устройствах и установленные приложения;

- использовать надежное защитное решение, которое вовремя распознает фишинговую ссылку или вредоносное ПО, такое как Kaspersky Premium.