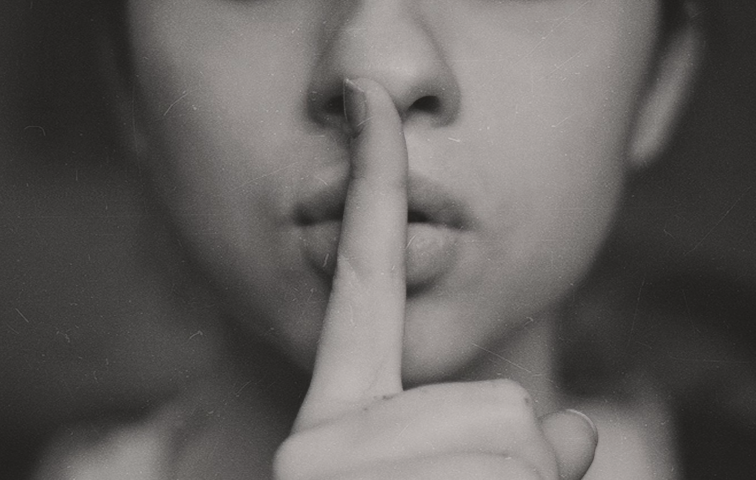

СМИ узнали о введении в Google ограничений для научных работ про ИИ

Alphabet Inc., материнская компания ИТ-гиганта Google, усилила контроль над научными работами своих сотрудников, посвященными искусственному интеллекту. Об этом сообщает Reuters со ссылкой на внутреннюю документацию компании.

Как минимум в трех случаях Google просила своих ученых воздерживаться от выставления некоторых аспектов ИИ в негативном ключе и стараться упоминать их в более позитивном.

Проверка научных работ прежде всего коснулась разработок в сфере ИИ, нацеленных на улучшение алгоритмов рекомендаций на разных платформах и сервисах Google (например, на YouTube или в поисковой системе). Требование связано с тем, что такие исследования могут коснуться этических вопросов при разделении пользователей на разные категории.

Согласно новому регламенту, авторы научных работ, прежде чем приступать к исследованиям на темы классификации пользователей по расовому, половому признаку, политическим предпочтениям, настроениям и убеждениям, должны проконсультироваться с юристами, отделом внутренней политики и службой по связям с общественностью.

Как пишет агентство, в одном из документов Google для научных сотрудников говорится, что «развитие технологий и растущая сложность внешней среды все чаще приводят к ситуациям, когда кажущиеся безобидными проекты поднимают этические, репутационные, нормативные или правовые вопросы».

По словам нескольких нынешних и бывших сотрудников Google, проверка «деликатных тем» дополняет стандартную проверку публикаций на предмет неразглашения коммерческой тайны и соответствия правилам компании.

По мнению старшего научного сотрудника Google Маргарет Митчелл и еще троих ученых, рекомендации компании являются цензурой, поскольку вмешиваются в изучение потенциального вреда от технологий. «Если мы что-то исследуем, руководствуясь своим профессиональным опытом, а нам не разрешается публиковать результаты из-за якобы некачественного рецензирования, то мы сталкиваемся с серьезной проблемой цензуры», — сказала Митчелл.

Митчелл высказала такое мнение на фоне увольнения своего непосредственного руководителя Тимнит Гебру в декабре. Гебру возглавляла группу из 12 ученых, которые занимались вопросами этики искусственного интеллекта. Ее уволили после отказа выполнять распоряжение не публиковать исследование, в котором говорится о неблагоприятном положении маргинальных групп населения из-за синтезатора речи на основе ИИ.

В список «деликатных тем» Google, согласно внутренним документам, входят также обсуждение нефтяной промышленности, Китая, Израиля, Ирана, COVID-19, страхование, геолокация, религия, беспилотный транспорт, системы рекомендаций интернет-контента и другие. При изучении этих и других щепетильных вопросов авторам статей рекомендовано придерживаться «позитивного тона».

В последние годы Google использует технологии искусственного интеллекта для понимания сложных поисковых запросов, оптимизации поисковой выдачи, системы рекомендаций на YouTube, системы автозаполнения в почтовых сервисах. По словам старшего вице-президента компании Джеффа Дина, за последний год ученые из Google опубликовали более 200 статей, посвященных ответственности за использование ИИ.

В мае израильский историк Юваль Харари в интервью РБК заявлял, что использование для оценок поведения людей искусственного интеллекта может привести к созданию «алгоритмов-расистов». Харари утверждал, что алгоритмы используют не чистую математику, а предубеждения своих разработчиков, которые указывают программе, на какие признаки человека обращать внимание. По мнению историка, в будущем это может привести к еще более сильной дискриминации по гендерному или расовому признаку.